Hearables are highly functional earphone-type wearables; however, existing input methods using stand-alone hearables are limited in the number of commands, and there is a need to extend device operation through hand gestures. In previous research on hearables for hand input, user understanding and gesture recognition systems have been developed. However, in the realm of user understanding, investigation concerning hand input with hearables remains incomplete, and existing recognition systems have not demonstrated proficiency in discerning user-defined gestures.

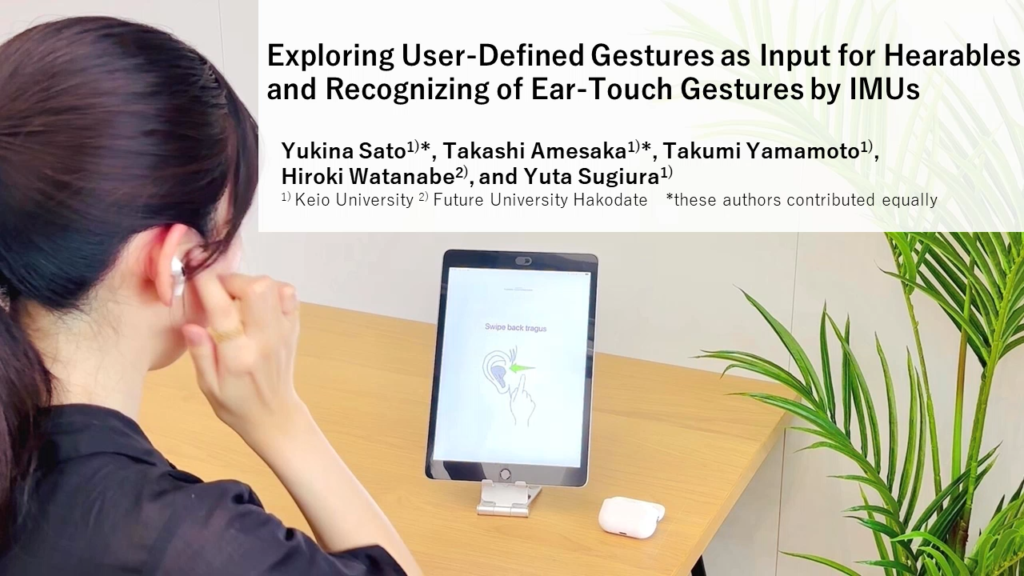

In this study, we conducted a gesture elicitation study (GES) assuming hand input using hearables under six conditions (three interaction areas × two device shapes). Then, we extracted ear-level gestures that the device’s built-in IMU sensor could recognize from the user-defined gestures and investigated the recognition performance. The results of sitting experiments showed that the gesture recognition rate for in-ear devices was 91.0% and that for ear-hook devices was 74.7%.

This study offers a comprehensive understanding of hand input for hearables, predicts diversification in input areas and device shapes, and contributes valuable insights to the design of future hearables. Furthermore, we demonstrate a highly compatible gesture recognition method tailored for hearables.

To be presented at MobileHCI 2024.

Publication

- Yukina Sato*, Takashi Amesaka*, Takumi Yamamoto, Hiroki Watanabe, Yuta Sugiura,

Exploring User-Defined Gestures as Input for Hearables and Recognizing of Ear-Level Gestures by IMUs, Proceedings of the ACM on Human-Computer Interaction (PACMHCI), Vol.8., No. MHCI, Article 258 (Sep. 2024), 23 pages, doi=10.1145/3676503. *Co-first authorship. [DOI]

ヒアラブルデバイスは高機能なイヤホン型ウェアラブルデバイスですが、現在の入力方法には制限があり、手のジェスチャーによる操作の拡張が求められています。これまでの研究では、ヒアラブルデバイスと手のジェスチャーに関するユーザー理解やジェスチャー認識システムが開発されましたが、手入力に関する調査は不十分で、既存の認識システムはユーザーが定義したジェスチャーによる調査が行われていませんでした。

本研究では、ヒアラブルデバイスを使ったハンズ入力を想定し、6つの条件(3つのインタラクションエリア×2つのデバイス形状)でGesture Elicitation Study(GES)を実施しました。そして、ユーザーが定義したジェスチャーの中から、デバイス内蔵のIMUセンサーで認識できる耳タッチレベルのジェスチャーを抽出し、その認識性能を調査しました。実験の結果、インイヤー型デバイスのジェスチャー認識率は91.0%、耳掛け型デバイスでは74.7%という結果が得られました。

この研究は、ヒアラブルのハンズ入力に対する包括的な理解を提供し、入力可能エリアやデバイス形状の多様化など、将来のヒアラブルデバイスの設計に貴重な知見をもたらします。

本研究はACM Journals PACM HCIに公開され、MobileHCI 2024にて発表します。

2 thoughts on “Exploring User-Defined Gestures as Input for Hearables and Recognizing Ear-Level Gestures with IMUs”

Comments are closed.